如何通过五步优化矢量拉力测试机性能:我的实战方法与避坑指南

第一步:先校准“基准线”,否则优化都是假动作

关键要点:把测量误差控制在可解释范围内

做矢量拉力测试,很多人一上来就想改算法、调参数,但我自己的经验是:如果基准线没打牢,所有性能优化都是“漂”的。我通常先做三件事:第一,拉一组标准砝码,覆盖整个量程,比如5%、20%、60%、90%四个点,每个点重复5次,算平均值和标准差,看线性和重复性;第二,用同一根样品在不同时间(早班、晚班),甚至不同操作员重复测试,专门观察零点漂移和操作影响;第三,把测试环境影响量化,比如温度变化每1℃,零点和满量程各漂多少。只有把这些误差数字化,你后面做的每一步优化才有方向,而不是凭感觉乱调。我的标准是:重复性误差控制在0.5%FS以内,零点漂移在2小时内不超过0.2%FS,如果达不到这个水平,我不会开始做性能提升,而是先排查传感器、放大电路和机械结构,避免在“带病设备”上浪费时间。

落地方法:建立一个“日常自检”模板

为了让这一步能真正落地,我建议直接在电脑里建一个固定的自检模板表格,比如用Excel或类似工具,列出:日期、环境温度、标准砝码值、仪器显示值、误差%、重复测量值、备注。每天开机前花10分钟做两点(例如10%和80%量程)快速校验,超过设定允许误差就禁止正式测试,先排查问题。我自己在几个车间推广这个方法后,故障报警和返工率明显下降,而且有了历史数据,后面你再和硬件工程师、软件工程师讨论升级方案时,有真实曲线和误差趋势做依据,决策会理性很多,而不是“感觉最近不太准”。这一点听上去很基础,但实际真正坚持做的团队不多,大部分性能问题就是卡在这里反复踩坑。

第二步:把矢量计算链路拆开,不要一口吃掉所有复杂度

关键要点:分模块验证,先搞定“力”,再谈“矢量”

矢量拉力测试机最大的难点之一,是多维力的合成和解耦。如果一开始就看最终矢量结果,问题很难定位。我自己的习惯是:先把矢量计算链拆成三段——单轴力采集、多轴坐标转换、矢量合成与滤波。单轴阶段重点看每个通道的灵敏度、滞后、噪声水平;坐标转换阶段验证传感器安装姿态、坐标系定义是否统一;最后才看矢量合成后的大小和方向稳定性。比如,我会先固定住除X轴外的所有方向,只给X方向施加已知力,理论上Y、Z分量应该接近零,如果此时Y、Z通道有明显输出,十有八九是安装偏心、传感器互相干扰或者坐标系设定出问题。这种逐段验证的方法,看似绕远,其实可以极大减少“算法不准”的无效争论,因为你能明确指出问题是在传感器机械安装、标定矩阵,还是在滤波参数。

落地方法:用简单矩阵工具快速“拆解矢量”

在工具上,我比较推荐用类似MATLAB、Octave或者Python+NumPy来做坐标转换和矢量合成的离线验证,实际工程里我常用的是一份固定脚本:输入传感器原始电压或力值、安装角度、标定矩阵,输出预期的矢量结果。现场调试时,把仪器实际输出数据导出,丢进脚本里算一遍,和仪器显示差多少,差在哪里,一目了然。很多时候,看出问题只需要做两组对比:理论模型结果 vs 仪器结果;单轴加载 vs 多轴加载。通过这种方式,你可以非常有针对性地改矢量算法,而不是“整体改系数”。我的经验是,只要这一步做扎实,多轴矢量误差能从5%以内压到2%以内,而且调试周期会大幅缩短。

第三步:优化采样与滤波,让“速度”和“稳定”兼得

关键要点:先确定真实需求,再谈刷新率

很多用户一提要求就是“刷新率要高”“响应要快”,但如果你不先问清楚真实工况,很容易走向过度采样和错误滤波。我的做法是先三问:第一,你关心的是瞬时峰值,还是稳定拉力趋势?第二,典型动作持续时间是毫秒级、秒级还是更长?第三,后端是人眼看数据还是自动控制系统用?如果是人工观察趋势,5~20Hz的刷新率就够了,关键是画面别抖;如果是控制系统要捕捉峰值,那要看动作频率,采样频率通常选为动作频率的5~10倍,再配合合适的数字滤波。滤波方面我比较常用的是适度平滑的IIR或移动平均,核心原则是:在能稳定读数的前提下,尽量保持信号相位延迟可预测。比如,移动平均窗口从5点加到21点,肉眼看上去更“稳”,但系统延迟可能从几十毫秒飙到几百毫秒,导致你永远追不上真实变化。

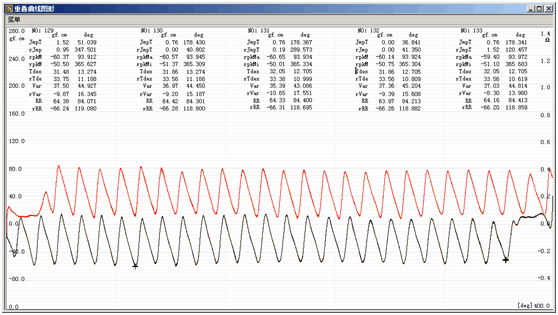

落地方法:用“双通道对比”调滤波参数

在现场调试时,我常用一个简单的小技巧:在上位机界面或者内部调试模式里,让同一个通道同时输出“原始数据”和“滤波后数据”两条曲线。一条用较高刷新率显示(比如100Hz),另一条按最终用户刷新率(比如10Hz)显示,边施加动态拉力边观察。如果你发现原始数据变化已经结束了,但滤波后数据还在缓慢爬升或下降,这说明滤波窗口偏大或者滤波类型不合适,需要及时收紧。这样的可视化对操作员也很友好,他们能直观理解“为什么我们不能把滤波调得特别稳”,减少很多沟通成本。我的经验是,通过这类可视化调参,一般能找到一个用户主观感受舒服、又不牺牲关键动态性能的平衡点。

第四步:从结构和工装入手,解决“力不纯”和重复性差的问题

关键要点:先让力路简单,再求算法复杂

矢量拉力测试机的一个常见误区,是过度依赖后端算法补偿前端结构缺陷。坦白讲,只要接触过现场你就会发现,导致结果飘的往往不是算法,而是力路不够“干净”:夹具装夹角度不一致、导向机构有卡滞、传感器受了弯矩和侧向力等。我自己的做法,是在任何算法优化之前,先做“结构体检”:第一,拆掉复杂夹具,用最简化、对称性好的工装做对比测试,看看结果是否明显变稳;第二,用千分表或高精度位移传感器检查加载过程中的位移轨迹,确认有没有明显的偏移或晃动;第三,对比不同操作员装夹同一工件的结果差异,如果差异超过预期,很可能是夹具设计过于依赖个人经验。这些问题如果不先解决,你可以做出再精妙的矢量算法,也只是帮结构问题“遮羞”,长期看维护成本和故障率都会上去。

落地工具:标准化工装+操作SOP

在工具层面,我非常推荐做两件事:一是设计一套标准化工装,尽量通过定位销、限位块、V型槽等结构,让工件“只能这样放”,降低人为自由度;二是配套一份图文并茂的操作SOP,明确每一步装夹动作、扭矩范围、检查项目。我的实践里,只要工装和SOP同步落地,测试结果的重复性通常能提升一个量级,有些项目从±5%的波动压到±1%以内。说句直白的,很多人以为自己缺的是高深算法,实际上最需要的是一套稳定、可复制的装夹方式。你先把这块做好,再谈算法优化,整个项目会轻松很多。

第五步:建立参数数据库和回溯机制,让优化可复制、可传承

关键要点:别让调出来的“好参数”只存在老工程师脑子里

矢量拉力测试机的性能优化,很容易变成“专家艺术”,谁调的谁知道,换个人就重来。我以前也吃过这个亏,后来形成了一个习惯:所有对性能有影响的关键参数,必须纳入“参数数据库”和版本管理。这里面的核心包括:标定系数和标定日期、滤波类型和参数、矢量解耦矩阵、采样频率和刷新策略、典型工况下的测试曲线样本等。每次对某一类产品做性能优化,我都会把“前后对比曲线”“参数变更点”“适用范围和限制条件”一起记录下来。这样做的好处是,当新型号产品或者新工况出现时,你可以直接查到历史上哪一套参数在类似条件下表现最好,而不是从零开始摸索。更重要的是,当团队成员变动时,新人只要按表操作,就能快速复现一个接近“祖传参数”的性能水平,避免因为经验断层导致质量波动。

落地方法:用简单表格+版本号管理参数

在具体实现上,其实不一定要上很重的系统。我常用的做法是:用电子表格管理一张“参数总表”,核心字段包括:设备编号、传感器型号、标定日期、软件版本、矢量算法版本、滤波参数、适用工况、验证结果摘要等;同时在软件界面给每套参数一个明确的“参数版本号”,并且把这个版本号写入每一条测试记录中。这样,任何一条有争议的测试数据,都可以追溯到当时用的是哪一套参数、一共调整过几次。久而久之,你会发现团队讨论从“感觉现在不行”变成“这个版本比上一个版本在某工况下多了2%的误差”,沟通效率和决策质量都会上一个台阶。说白了,就是把经验固化成“可查、可复现”的资产,而不是让每次优化都重新交学费。

TAG: